Molti avranno visto l’immagine di Papa Francesco con un piumino bianco di alta moda fino ai piedi, o di Donald Trump arrestato con la forza dalla polizia americana in una via affollata. Queste immagini sono create al computer grazie a nuovi algoritmi di intelligenza artificiale generativa, capaci di produrre risultati straordinariamente somiglianti a fotografie digitali. In effetti, queste immagini sono ricostruzioni basate su scatti reali, guidate dall’operatore umano che fornisce istruzioni verbali o scritte sul risultato desiderato.

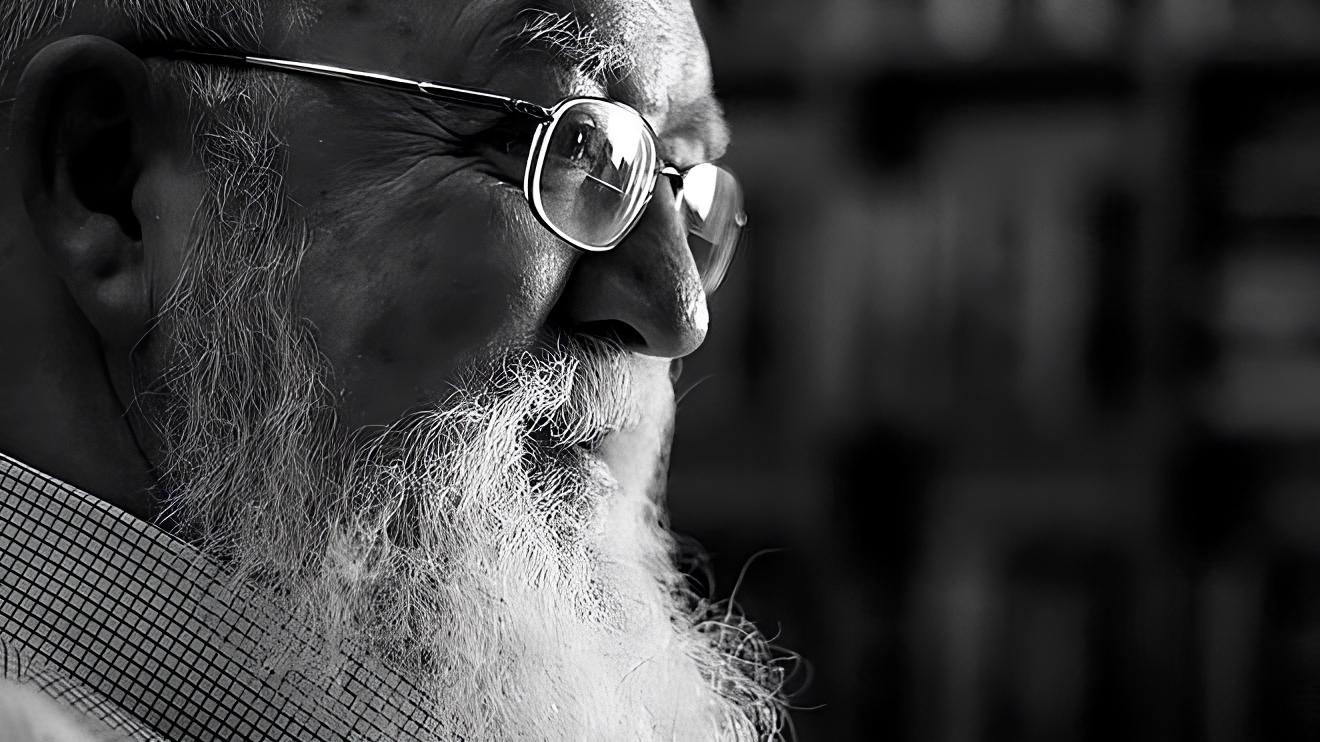

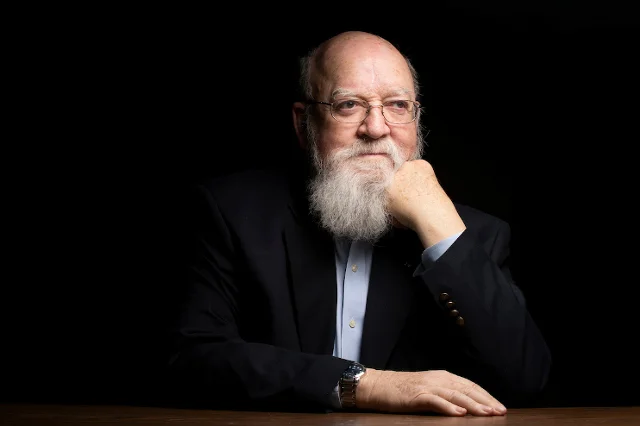

Alcune delle preoccupazioni di Daniel Clement Dennett nei suoi ultimi anni di vita produttiva riguardavano proprio l’avanzamento della tecnologia. Il grande filosofo e scienziato cognitivo, nato nel 1942 e scomparso ad aprile scorso, aveva colto appieno i pericoli connessi con il deepfake. Questa tecnologia, basata sull’IA, permette di creare video, immagini e audio falsi estremamente realistici. Tali contenuti vengono generati utilizzando reti neurali artificiali, in particolare le reti generative antagonistiche, capaci di apprendere e replicare dettagli complessi di volti, voci e movimenti umani.

I deepfake video possono sostituire il volto di una persona con quello di un’altra, facendo sembrare che qualcuno stia dicendo o facendo qualcosa che in realtà non ha mai fatto. Le applicazioni più insidiose di questa tecnologia sono state finora quelle a carattere pornografico, colpendo persino celebrità come la cantante Taylor Swift.

In realtà, i software non hanno scopi né prendono decisioni autonomamente, se non quelle che noi stessi affidiamo loro. Tuttavia, in linea con l’idea dennettiana dell’atteggiamento intenzionale, è utile attribuire a questi sistemi credenze, desideri e intenzioni per spiegare e prevedere il loro comportamento, come se fossero agenti razionali. Questo approccio, comune anche tra i non esperti che spesso antropomorfizzano animali domestici, come cani e gatti o strumenti tecnologici complessi, aiuta nella comprensione di tali entità. Il vero problema risiede nell’uso che noi possiamo fare degli algoritmi generativi.

Dennett ha sottolineato come le notizie false e i deepfake generati dall’IA possano erodere la fiducia pubblica nei media e in ogni fonte di conoscenza. Ancora peggio, a essere minate saranno la testimonianza e le prove come strumenti per avvicinarsi alla verità. La capacità di creare messaggi altamente convincenti ma falsi può portare a una diffusa disinformazione, rendendo difficile per le persone distinguere tra vero e verosimile.

In questo contesto, l’intelligenza artificiale può essere quindi utilizzata per manipolare l’opinione pubblica diffondendo narrazioni artefatte ma realistiche. Tale fenomeno può avere un impatto fortemente negativo sui processi democratici, poiché interi processi elettorali potrebbero essere influenzati da notizie e dati fabbricati ad arte. I prodotti sempre più sofisticati generati dall’IA rendono sempre più difficile verificarne l’autenticità, amplificando il problema della disinformazione.

“Il denaro – scrive Dennett – esiste da diverse migliaia di anni, e fin dall’inizio la contraffazione è stata riconosciuta come un crimine molto grave, un crimine che in molti casi ha condotto alla pena capitale perché mina la fiducia su cui si basa la società. Oggi, per la prima volta nella storia, grazie all’intelligenza artificiale, è possibile per chiunque costruire persone contraffatte che possono passare per reali in molti dei nuovi ambienti digitali che abbiamo realizzato. Queste persone contraffatte sono le creazioni più pericolose nella storia umana, capaci di distruggere non solo le economie, ma la libertà stessa. Prima che sia troppo tardi (potrebbe già essere troppo tardi), dobbiamo proibire sia la creazione di persone contraffatte sia la “diffusione” di persone contraffatte. Le pene per entrambi i reati dovrebbero essere estremamente severe, dato che è in gioco la nostra civiltà”.

Serve, pertanto, una maggiore consapevolezza dei rischi, l’adozione di tecniche più efficaci per svelare il falso e l’implementazione di norme severe per i trasgressori. Questa è l’ultima lezione che Daniel Dennett ci ha lasciato.